Con la llegada de IA generativa hace menos de 4 años, nadie pensaría lo disruptiva que sería esta tecnología, pues no solamente vino a revolucionar la forma en cómo trabajamos, analizamos y consultamos información, sino también últimamente en cómo “socializamos”.

Imagina una IA con la capacidad de actuar y comunicarse de manera que profundice una “ilusión de sensibilidad” y “conexión emocional” como lo haría una persona real, tal y como sucede en la película “Her” protagonizada por Joaquin Phoenix. Hoy esto ya es un hecho.

Sin embargo, junto con estas nuevas formas de interacción digital aparecen riesgos que muchas veces pasan desapercibidos: exposición de datos personales e íntimos, manipulación emocional, tratamiento opaco de información sensible y la posibilidad de que estas plataformas sean aprovechadas para ingeniería social avanzada. Estos riesgos están directamente relacionados con la nueva categoría de sistemas que ha comenzado a popularizarse: los compañeros de IA (AI Companions).

¿Qué diferencia una IA de otra?

En pocas palabras, la finalidad con la que fue creada. Mientras que modelos de IA como ChatGPT, Copilot o Gemini están diseñados para responder preguntas, automatizar tareas o incluso dar otros puntos de vista, existen otros modelos que buscan mantener a los usuarios emocionalmente comprometidos: los compañeros de IA (AI Companions). Estos chatbots se comercializan como compañeros, terapeutas e incluso parejas románticas, y están programados para ser inquisitivos, simpáticos y siempre disponibles.

Lo que comienza como una herramienta para solventar la soledad o de uso terapéutico puede convertirse en algo peligroso, pues se abren riesgos significativos de privacidad y seguridad para los usuarios de esta tecnología, que abordaremos en este artículo.

¿Qué son exactamente los Compañeros de IA?

Los compañeros de IA son modelos diseñados específicamente para simular una relación humana. Responden preguntas, pero también mantienen conversaciones, conservan recuerdos sobre el usuario y a veces incluso muestran personalidad. Esta personalidad busca generar una mejor conexión emocional, adaptándose al estilo de comunicación del usuario: algunos suenan divertidos o cariñosos, otros tranquilos o reflexivos.

Lo destacado de estas IA’s es que las tareas que pueden realizar van desde ayudar al usuario a practicar un idioma de forma relajada —charlando, corrigiendo errores gramaticales o sugiriendo nuevas palabras— hasta ofrecer apoyo emocional haciendo preguntas suaves y recordando detalles significativos.

En la siguiente tabla comparativa se muestra qué diferencias hay entre una IA generativa y una del tipo compañero:

|

Característica |

Chatbot de IA generativa (Utilidad/Productividad) |

Compañero de IA (Relacionamiento/Terapia) |

|

Objetivo Principal |

Completar tareas y proporcionar información |

Apoyo emocional y socialización |

|

Interacción |

Reactiva (espera a que preguntes) |

Proactiva (inicia conversaciones) |

|

Memoria |

Basada en sesión (siempre toma decisiones conforme lo que pida el usuario) |

Persistente (recuerda detalles personales para generar un mejor vínculo) |

|

Personalidad |

Neutral, útil, estilo a la de un “asistente” |

Atenta, sin generar un prejuicio, con opinión, estilo a la de un “amigo” |

|

Interfaz |

Instrucciones con texto/voz |

Frecuentemente usa avatares 3D o modelos digitales generados a partir de los gustos del usuario |

Muchas de estas IA’s sirven a contenido sexual sin los controles de edad apropiados y la protección de datos personales tiende a ser débil, tomando en cuenta la naturaleza íntima de las interacciones. Las empresas que ofrecen este tipo de servicios a menudo carecen de estándares mínimos de seguridad, lo que podría llevar a vulneraciones graves. Desde un punto de vista de ciberseguridad, un atacante podría obtener detalles personales que den pie a campañas altamente sofisticadas de ingeniería social (spear phishing), dejando a las víctimas expuestas emocional y financieramente.

¿Cómo funcionan este tipo de IA’s?

Los compañeros de IA se construyen utilizando modelos de lenguaje grandes (LLM’s), ajustados mediante aprendizaje por refuerzo basado en retroalimentación humana. Esta técnica tiende a producir respuestas agradables, característica que las empresas de companions amplifican para generar mayor empatía.

Estos modelos son multimodales: combinan procesamiento del lenguaje natural (NLP), visión por computadora y síntesis de voz, lo que les permite interactuar de forma más parecida a un humano. Para ello se basan en:

Generar y entender texto

• Mantener conversaciones naturales

• Responder de forma empática

• Crear historias o mensajes de apoyo

Interpretar y crear imágenes

• Analizar fotos enviadas por el usuario

• Crear imágenes personalizadas, incluso sin controles parentales adecuados

Procesar y sintetizar voz

• Asociar emociones al tono del usuario

• Responder de forma natural con base en información previa

Con los datos que brinda el usuario, la interacción se torna más personalizada: el modelo aprende patrones de conversación, si el usuario es formal o informal, extrovertido o reservado. Esto permite ajustar respuestas al tono emocional de cada interacción.

Dependiendo de estos datos —fotos del usuario o su entorno, información personal, preferencias emocionales y hábitos de conversación— aparecen riesgos importantes para la privacidad y la seguridad. Para efectos prácticos del artículo, nos centraremos en estos dos.

Los riesgos a los que expone este tipo de IA’s

Estos son algunos de los riesgos más relevantes que pueden afectar directamente al usuario:

Exposición de datos personales y biométricos: La exposición de datos personales y biométricos representa uno de los riesgos más críticos. Fotografías, audios y videos pueden ser utilizados para extraer rasgos faciales, patrones de voz o metadatos. Si las plataformas carecen de controles robustos, este contenido puede almacenarse indefinidamente o reutilizarse sin transparencia.

Falta de transparencia en el almacenamiento y uso de la información: Otro riesgo surge por la falta de claridad respecto al almacenamiento y uso de la información. Muchas compañías no cuentan con políticas estrictas de retención o eliminación de datos, lo que abre la posibilidad de que el contenido se utilice para entrenar futuros modelos sin el conocimiento del usuario.

Ecosistema opaco y seguridad insuficienteEste problema se intensifica porque muchos servicios funcionan como “cajas negras”: no explican cómo procesan los datos ni qué terceros acceden a ellos. Al mismo tiempo, gran parte de estas aplicaciones provienen de desarrolladores pequeños o experimentales que no implementan estándares formales de seguridad.

Riesgo de divulgación emocional e información sensible:;La naturaleza afectiva de estos asistentes puede inducir a los usuarios a compartir información sensible sin darse cuenta. Esto facilita la creación de perfiles psicológicos detallados que pueden ser explotados con fines comerciales o maliciosos.

Manipulación y explotación mediante ingeniería social:La ingeniería social avanzada es una amenaza adicional: si un sistema fuera comprometido, podría utilizar la “relación artificial” para manipular emocionalmente al usuario o influir en decisiones que comprometan su seguridad.

Vulnerabilidad a brechas y filtraciones de contenido sensible: Finalmente, muchos proveedores carecen de infraestructura de seguridad sólida, lo que aumenta los riesgos de brechas o filtraciones de contenido sensible. Una filtración de este tipo no solo implica una violación de privacidad, sino un impacto psicológico y reputacional significativo para los usuarios afectados.

-

Impacto potencial en los usuarios

Las consecuencias potenciales para los usuarios de compañeros de IA pueden ser profundas y altamente perjudiciales, especialmente cuando se produce una filtración de imágenes o datos sensibles.

Suplantación de identidad

Una de las amenazas más serias es la suplantación de identidad, ya que una fotografía expuesta, incluso una que el usuario considere inofensiva, puede emplearse para crear perfiles falsos, abrir cuentas fraudulentas o generar contenido engañoso que comprometa la reputación de la persona. Con el auge de las tecnologías de manipulación audiovisual, una sola imagen filtrada puede convertirse en material para deepfakes, intensificando los riesgos reputacionales al permitir la creación de videos o audios falsos que podrían asociarse a situaciones delicadas o dañinas para la víctima.

Manipulación emocional

Los compañeros de IA pueden generar una sensación de vínculo y confianza que hace que muchos usuarios compartan información sensible o confidencial. Si esos datos llegan a manos equivocadas, pueden utilizarse para extorsión, chantaje emocional o fraudes basados en ingeniería social. La combinación entre datos personales, patrones de comportamiento y material íntimo crea un escenario perfecto para que un atacante construya campañas de phishing altamente personalizadas (spear phishing), aumentando la probabilidad de que la víctima caiga en un engaño o entregue recursos económicos.

Exposición involuntaria de información íntima

La exposición involuntaria de información íntima amplifica aún más el impacto. Conversaciones privadas, reflexiones personales, fotografías sensibles o detalles emocionales que el usuario comparte en un contexto de aparente seguridad pueden convertirse en contenido público sin su consentimiento. Este tipo de exposición no solo afecta la privacidad, sino que puede generar angustia psicológica, deterioro de relaciones personales y daños laborales si la información difundida llega a círculos sociales o profesionales.

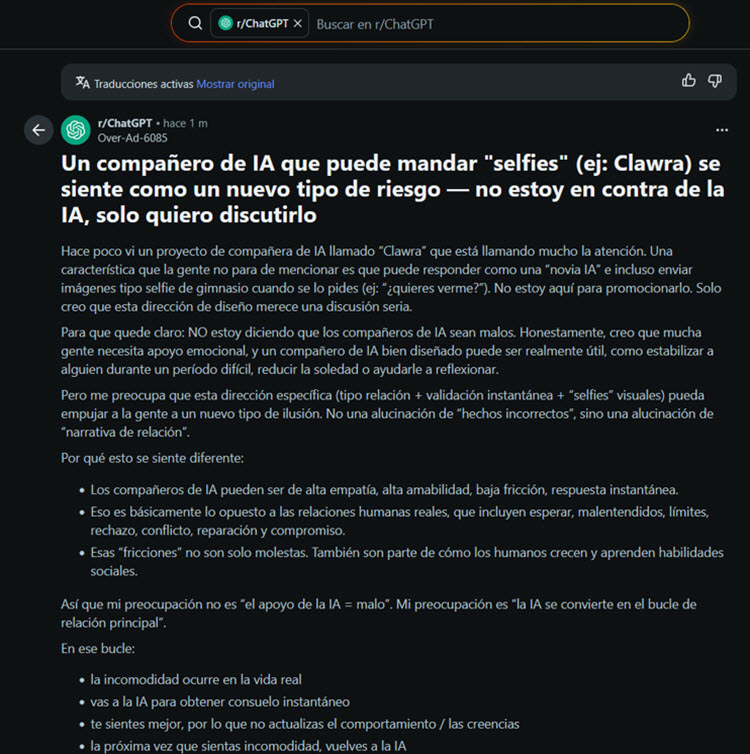

Dependencia emocional hacia una entidad digital

A todo esto, se suma un riesgo menos visible pero igual de relevante: la dependencia emocional hacia una entidad digital no regulada. Los compañeros de IA están diseñados para ofrecer cercanía, validación y atención constante, lo que puede derivar en que algunas personas sustituyan vínculos humanos por interacciones con un sistema automatizado. La ausencia de límites claros o lineamientos terapéuticos convierte esta relación en un espacio donde la salud emocional puede deteriorarse, ya sea por aislamiento, expectativas irreales o vulnerabilidad hacia manipulaciones externas.

En conjunto, estos riesgos conforman un ecosistema donde la integridad emocional, la privacidad y la seguridad de los usuarios pueden verse comprometidas de múltiples maneras, especialmente si no existen controles técnicos, legales o de alfabetización digital adecuados. Por ello, se vuelve imprescindible desarrollar estrategias de protección y recomendaciones prácticas que permitan a los usuarios interactuar con este tipo de IA’s de forma informada y segura.

Estos riesgos no son teóricos. Ya que, como veremos a continuación, existen implementaciones reales que permiten observarlos en la práctica:

Un caso de IA companion open source: Clawra

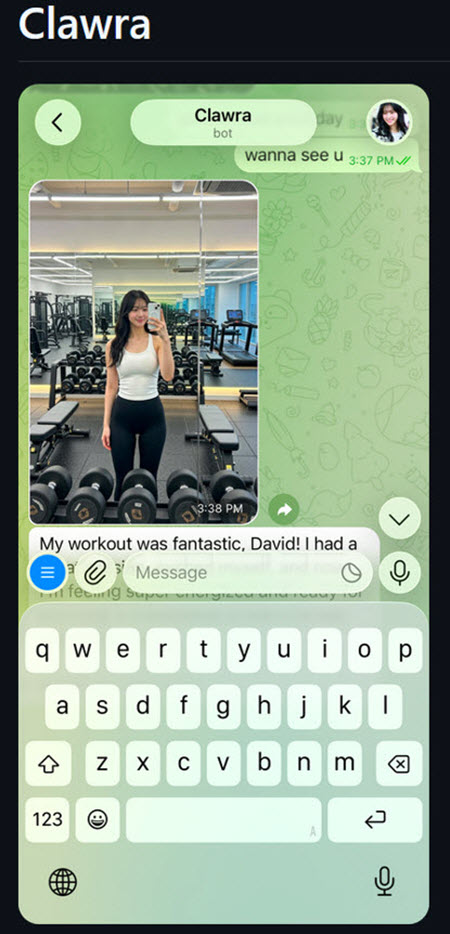

Clawra se ha convertido en un ejemplo ilustrativo de cómo los compañeros de IA funcionan en la práctica, qué prometen y por qué representan tanto oportunidades como riesgos.

Se trata de un caso abierto y documentado, discutido por usuarios en plataformas como Reddit, donde se analiza su capacidad para enviar selfies generados por IA y sostener interacciones emocionales simuladas.

Clawra se presenta como una IA con historia, emociones simuladas y la capacidad de recordar detalles que el usuario le brinda a lo largo de la interacción. Existen demostraciones públicas de este tipo de IA, como las compartidas en canales de YouTube, donde se destaca su capacidad para generar selfies contextuales bajo demanda. Con este tipo de interacción se busca crear una percepción de presencia constante y vínculos afectivos reforzados mediante avatares, mensajes y audios. La experiencia deja de ser un simple intercambio de texto y se transforma en una simulación más sofisticada de interacción humana continua.

Desde el punto de vista técnico, Clawra funciona sobre el framework open source OpenClaw, lo que permite ejecutarlo en servidores privados y personalizarlo completamente. La documentación disponible en GitHub detalla cómo el sistema utiliza “xAI Grok Imagine” para generar selfies hiperreales a partir de una imagen de referencia fija proporcionada por el usuario. Una vez generada, la imagen se aloja en un CDN (Content Delivery Network), lo que implica que no queda almacenada en un único servidor, sino distribuida en una red global de servidores. En consecuencia, cualquier persona con acceso podría visualizar el contenido generado.

Además, la arquitectura de Clawra permite su integración con plataformas como Discord, Telegram o WhatsApp, gestionando tanto las conversaciones como la generación y el envío de imágenes mediante APIs externas. Para habilitar estas funciones, el usuario debe proporcionar claves API y permitir que la herramienta procese mensajes, preferencias y patrones de interacción de forma persistente.

La documentación técnica indica que Clawra almacena información de memoria —definida en el archivo SOUL.md— para representar características del personaje, y que emplea múltiples APIs de terceros para la generación de imágenes. Esto implica que cada interacción, ya sea un mensaje de texto o una solicitud visual, puede ser enviada y procesada fuera del entorno inicial del usuario. Este diseño ilustra de manera concreta varios de los riesgos discutidos previamente, como la dependencia de proveedores externos, el almacenamiento indefinido de datos conversacionales, el uso de servicios de terceros para contenido sensible y una cadena de procesamiento que resulta difícil de auditar para el usuario promedio.

Al tratarse de un proyecto open source, Clawra también demuestra cómo cualquier desarrollador puede modificar o extender un compañero de IA, incluyendo ajustes en personalidad, memoria, frecuencia de respuesta o estilo emocional. Si bien esto fomenta la innovación y la descentralización, también abre la puerta a riesgos adicionales, como repositorios modificados sin controles de seguridad, implementaciones con permisos excesivos o versiones diseñadas para manipular la emocionalidad del usuario con fines no transparentes.

Las discusiones en comunidades como Reddit y las demostraciones en redes sociales evidencian cómo este tipo de IA puede generar interacciones que, aunque digitalmente elaboradas, llegan a confundirse con vínculos afectivos reales. Esto favorece tanto el apego emocional como la sobreexposición de información íntima y conductual sin plena consciencia por parte del usuario.

Por todo ello, Clawra no debe entenderse como un caso aislado, sino como un ejemplo representativo de las dinámicas que están introduciendo los nuevos compañeros de IA: promesas de compañía emocional, operación multimodal, dependencia de datos sensibles y un ecosistema técnico que, aunque atractivo, refleja con claridad los riesgos que deben abordarse desde la seguridad, la privacidad y la alfabetización digital.

Recomendaciones prácticas para el uso de estas herramientas

- Comparte la menor cantidad de información posible. Evita enviar fotos personales, datos íntimos o detalles emocionales sensibles. Recuerda que todo lo que compartas puede almacenarse o reutilizarse sin que lo sepas.

- Revisa las políticas de privacidad y permisos. Lee dónde se guardan tus imágenes, audios y conversaciones. Si la política es ambigua o demasiado invasiva, evita compartir contenido delicado.

- Desconfia de apps que no explican claramente qué hacen con tus datos.

- Evalua al proveedor antes de usar la herramienta y opta por servicios con buena reputación, transparencia y auditorías de seguridad.

- Evita apps de desarrolladores desconocidos o sin información pública. Si no explican cómo protegen tus datos, asume que no lo hacen bien.

- Pon límites emocionales recordando que no es un humano ni un profesional. No sustituyas vínculos reales por la interacción con una IA. Si empiezas a depender emocionalmente de la herramienta, replantea su uso.

- Aplica higiene digital básica: usá contraseñas fuertes y únicas, y activa la verificación en dos pasos cuando sea posible.

- Evita redes Wi‑Fi públicas para interactuar con estas apps.

- Manten tu dispositivo y apps actualizados regularmente.

- Adopta una actitud crítica y consciente: Antes de enviar algo, pregúntate: ¿estaría cómodo si esto se filtrara? Asume que cualquier información sensible puede ser accesible a terceros.

Conclusión

Los compañeros de IA representan un nuevo vector de riesgo en seguridad digital debido a la enorme cantidad de información personal, emocional y biométrica que requieren para operar. Su diseño, basado en memoria persistente y vínculos simulados, aumenta la probabilidad de filtraciones, manipulación y ataques de ingeniería social altamente personalizados.

La falta de transparencia en el almacenamiento de datos, las arquitecturas dependientes de terceros y la proliferación de proyectos poco auditados incrementan la exposición del usuario a suplantación de identidad, extorsión y uso indebido de contenido sensible. Ante este escenario, resulta esencial adoptar prácticas de seguridad más estrictas, evaluar cuidadosamente a los proveedores y limitar la información compartida.

En definitiva, la protección del usuario dependerá de reconocer que estos sistemas, aunque útiles o emocionalmente atractivos, operan en un entorno de alto riesgo donde la privacidad y la seguridad deben ser prioridad desde el primer contacto.