Google es el buscador más utilizado en el mundo. Todos los días, millones y millones de usuarios realizan búsquedas para encontrar sitios que se ajusten con sus intereses. Sin embargo, este buscador posee muchas funcionalidades que permiten realizar búsquedas muchas más precisas. Estas búsquedas pueden, en algunos casos, brindar información sensible de los servidores web dejándolos expuestos a que sean vulnerados por ciberdelincuentes.

Los parámetros que Google admite, facilitan de forma notoria muchas de las búsquedas permitiendo realizar filtrados muchos más complejos y obtener resultados con mayor precisión. Sin embargo, estas ventajas pueden ser utilizadas por los ciberdelincuentes. En muchos casos, los atacantes realizan búsquedas para encontrar servidores vulnerables y poder acceder a los mismos con diferentes motivos. Este tipo de búsquedas con fines maliciosos o no éticos, se conoce bajo el nombre de Google Hacking. Los motivos de estas prácticas pueden variar desde un defacement hasta alojar malware en el propio servidor para propagar el mismo a lo largo de Internet.

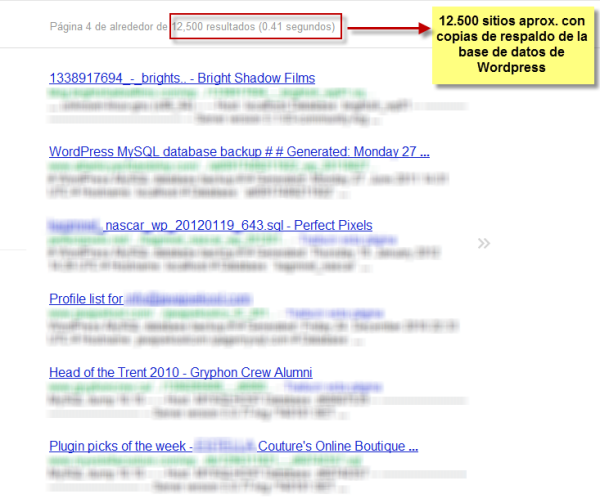

Existen algunos ejemplos de Google Dorks que incluso se exponen a lo largo de Internet. Para citar algún ejemplo y poder visualizar cuál es el impacto, es posible obtener resultados de todos aquellos servidores que poseen copias respaldo de sus bases de datos que utiliza Wordpress. En la siguiente captura puede visualizarse cuál es el resultado de la búsqueda:

Esta búsqueda arrojó 12500 resultados, lo que significa que aproximadamente esa cantidad de servidores realizaron respaldos de las bases de datos que utilizan Wordpress. Esta información puede ser accedida por ciberdelincuentes, y es factible que allí encuentren datos críticos como las credenciales de acceso de los usuarios que utilizan la plataforma de blogging en ese servidor.

Este tipo de información no debería ser accesible públicamente. Sin embargo en variadas oportunidades los administradores de los sitios cometen el error de pensar que guardando los archivos de respaldo en alguna carpeta oculta no es posible visualizarla. No obstante, cuando el Crawler de Google (Googlebot) pasa por ese servidor, lo indexa y pasa a formar parte del contenido que puede buscarse.

¿Cómo es posible que este tipo de información no sea accesible?

En primera instancia es recomendable configurar el archivo robots.txt. Este archivo permite indicarle a los crawlers que carpetas dentro del servidor no debe indexar y cuales sí. De esta manera las carpetas que contengan información sensible no formarán parte del índice del buscador. Un ejemplo de una entrada en el archivo es:

User-agent: *

Disallow: /cgi-bin/

Disallow: /tmp/

Las entradas expuestas en el ejemplo indican a cualquier crawler (User-agent: *) que no indexen los directorios /cgi-bin/ y /tmp/.

Otra alternativa para incrementar la seguridad es la utilización de meta-etiquetas (meta-tag) indicándole a los robots (crawlers) que no indexen esa página. A continuación puede visualizarse un ejemplo de una meta-etiqueta que indica que no se indexe ningún enlace del sitio.

<META NAME="ROBOTS" CONTENT="NOINDEX, NOFOLLOW">

Otra de las funcionalidades que debe ser deshabilitada, en caso de no ser necesaria, es la del listado de directorios. Esto permite al atacante tener una completa noción de los archivos disponibles dentro del servidor. La funcionalidad debe deshabilitarse a través de los archivos de configuración. En el caso de Apache, para deshabilitar esta opción, es necesario editar el archivo httpd.conf.

Finalmente, es de gran importancia configurar el archivo .htaccess. Este archivo permite, entre otras funcionalidades que posee, restringir el acceso a directorios críticos dentro del servidor web. De esta forma, si Google indexó un directorio crítico pero el archivo .htaccess está configurado correctamente, el ciberdelincuente no podrá acceder al directorio en cuestión.

Es importante tener en cuenta el concepto de que cuando un servidor es expuesto a Internet, el mismo será visible a todo el mundo. Por lo tanto, la seguridad de este servidor debe ser gestionada y auditada. Asimismo, debe contemplarse que cualquier exposición de información crítica puede atentar contra la seguridad e integridad del mismo.

Fernando Catoira

Analista de Seguridad